KI beschleunigt Herzbildgebung

Ein internationales Forscherteam, dem auch Wissenschaftler der Technischen Universität Graz angehören, arbeitet daran, die Untersuchung des Herzens mit Hilfe von Kardio-MRT zu beschleunigen, ohne dass die Qualität der Daten leidet. Sie nutzen Self-Supervised Learnings, eine Mischung aus überwachtem und unüberwachtem Lernen im Bereich des maschinellen Lernens.

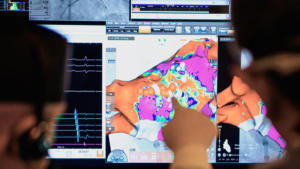

Der Einsatz von Magnetreonanztomografie (MRT) in der Herzdiagnostik ist inzwischen Standard. Diese Untersuchung erzielt eine hohe räumliche Auflösung und verursacht keine Strahlenbelastung. Allerdings setzt sich ein Bild aus den Daten vieler Einzelmessungen zusammen, deshalb ist das Kardio-MRT sehr zeitaufwendig. Bis zu 60 Minuten dauert es, bis die Messungen durchgeführt und der Computer die Bilder berechnet hat. Der Einsatz von Künstlicher Intelligenz soll das Verfahren nun beschleunigen und damit auch günstiger machen. Denn KI könnte auch mit weniger Messdaten auskommen. Die Voraussetzung dafür sind jedoch perfekte Bilder, mit denen die KI-Modelle trainiert werden können. Bisher waren Bilder des schlagenden Herzens zu unscharf. Nun ist es einer internationalen Forschungsgruppe um Martin Uecker und Moritz Blumenthal vom Institute of Biomedical Imaging der TU Graz gelungen, präzise Live-MRT-Bilder auch ohne solche Trainingsbilder und anhand sehr weniger MRT-Daten herzustellen.

Uecker und Blumenthal nutzen für das Training ihres Machine-Learning-Modells Methoden des „Self-Supervised Learnings“, einer Mischung aus überwachtem und unüberwachtem Lernen im Bereich des maschinellen Lernens. „Wir haben die vom MRT-Gerät gelieferten Messdaten in zwei Portionen aufgeteilt. Aus der ersten, größeren Datenportion rekonstruiert unser Machine-Learning-Modell das Bild. Anschließend versucht es, auf Basis des Bildes die ihm vorenthaltene, zweite Portion der Messdaten zu berechnen“, so Blumenthal.

Gelingt dies dem System nicht oder nur schlecht, muss das zuvor rekonstruierte Bild falsch gewesen sein. In so einem Fall wird das Modell aktualisiert, es erstellt eine neue verbesserte Bildvariante und versucht erneut, die zweite Datenportion zu berechnen.

Dieser Vorgang wird so lange wiederholt, bis das Ergebnis stimmig ist. Dabei lernt das System aus einer Vielzahl der Rekonstruktionen in diesem Trainingsprozess, wie gute MRT-Bilder aussehen sollten. Damit wird das Modell darauf vorbereitet, in der späteren Anwendung direkt ein gutes Bild zu berechnen. Für Uecker ist das Verfahren bereits anwendungsreif, „auch wenn es vermutlich noch etwas dauern wird, bis es in der Praxis auch tatsächlich eingesetzt wird“.

Die neue Methode könnte auch andere MRT-Anwendungen schneller und damit günstiger machen, so zum Beispiel die quantitative MRT, bei der physikalische Gewebe-Parameter exakt gemessen und quantifiziert werden. „Bisher dauern quantitative MRT-Messungen aber oft sehr lang. Mit unserem Machine-Learning-Modell konnten wir diese Messungen ohne Qualitätseinbußen stark beschleunigen“, so Uecker.

An der internationalen Kooperation des Institute of Biomedical Imaging waren unter anderem auch Kardiologen, Mathematiker und MRT-Forscher der Universitätsmedizin Göttingen, der Universität Innsbruck und der Harvard Medical School beteiligt. Die Algorithmen und MRT-Daten sind öffentlich, wodurch andere Forscher die Ergebnisse direkt nachvollziehen und auf der neuen Methode aufbauen können. Ihre Erkenntnisse veröffentlichten die Wissenschaftler kürzlich in Magnetic Resonance in Medicine.

BIOTRONIK

BIOTRONIK NVision

NVision Evotec SE

Evotec SE